Интеллектуальный агент - Intelligent agent

В области искусственного интеллекта , интеллектуальный агент ( IA ) ничего , что воспринимает его окружение, принимает меры автономны для достижения целей, и может улучшить свою работу с обучения или использовать знание . Они могут быть простыми или сложными - термостат считается примером интеллектуального агента, как и человек, как и любая система, которая соответствует определению, например, фирма , государство или биом .

Ведущие учебники по искусственному интеллекту определяют «искусственный интеллект» как «изучение и создание интеллектуальных агентов», определение, которое рассматривает целенаправленное поведение как суть интеллекта. Агенты, направленные на достижение цели, также описываются с использованием термина, заимствованного из экономики , « рациональный агент ».

У агента есть «целевая функция», которая включает в себя все цели IA. Такой агент предназначен для создания и выполнения любого плана, который по завершении максимизирует ожидаемое значение целевой функции. Например, агент обучения с подкреплением имеет «функцию вознаграждения», которая позволяет программистам формировать желаемое поведение IA, а поведение эволюционного алгоритма формируется «функцией приспособленности».

Интеллектуальные агенты в искусственном интеллекте тесно связаны с агентами в экономике , и версии парадигмы интеллектуальных агентов изучаются в когнитивной науке , этике , философии практического разума , а также во многих междисциплинарных социально-когнитивных моделях и компьютерных социальных симуляциях .

Интеллектуальные агенты часто схематически описываются как абстрактная функциональная система, подобная компьютерной программе. Абстрактные описания интеллектуальных агентов называются абстрактными интеллектуальными агентами ( AIA ), чтобы отличать их от их реализаций в реальном мире. Автономный интеллектуальный агент предназначен для функции при отсутствии вмешательства человека. Интеллектуальные агенты также тесно связаны с программными агентами (автономная компьютерная программа, выполняющая задачи от имени пользователей).

Определение искусственного интеллекта

Информатика определяет исследование ИИ как исследование интеллектуальных агентов . Ведущий учебник AI определяет «агент» , как:

- «Все, что можно рассматривать как воспринимающее окружающую среду с помощью датчиков и действующее на эту среду с помощью исполнительных механизмов»

определяет «рационального агента» как:

- «Агент, который действует так, чтобы максимизировать ожидаемую ценность показателя производительности, основанного на прошлом опыте и знаниях».

и определяет область исследований «искусственного интеллекта» как:

- «Исследование и конструирование рациональных агентов»

Аналогичное определение ИИ дано Капланом и Хэнлайном: «Способность системы правильно интерпретировать внешние данные, учиться на них и использовать полученные знания для достижения конкретных целей и задач посредством гибкой адаптации».

Пэдхэм и Виникофф (2005) соглашаются с тем, что интеллектуальный агент находится в среде и реагирует (своевременно, хотя и не обязательно в реальном времени) на изменения среды. Однако интеллектуальные агенты также должны активно и гибко преследовать цели. Необязательные пожелания включают, чтобы агент был рациональным и чтобы агент был способен анализировать убеждение-желание-намерение .

Преимущества этого определения

С философской точки зрения он избегает нескольких строк критики. В отличие от теста Тьюринга , он никоим образом не относится к человеческому интеллекту. Таким образом, нет необходимости обсуждать, является ли это «реальный» или «смоделированный» интеллект (т.е. «синтетический» или «искусственный» интеллект), и не указывает на то, что такая машина обладает разумом , сознанием или истинным пониманием (т. Е. это не подразумевает « сильную гипотезу ИИ » Джона Сирла ). Он также не пытается провести четкую границу между поведением, которое является «разумным», и поведением, которое является «неразумным» - программы нужно измерять только с точки зрения их целевой функции.

Что еще более важно, он имеет ряд практических преимуществ, которые помогли продвинуть исследования ИИ вперед. Он обеспечивает надежный и научный способ тестирования программ; исследователи могут напрямую сравнивать или даже комбинировать различные подходы к изолированным проблемам, задавая вопрос, какой агент лучше всего максимизирует данную «целевую функцию». Это также дает им общий язык для общения с другими областями, такими как математическая оптимизация (которая определяется в терминах «целей») или экономика (в которой используется то же определение « рационального агента »).

Целевая функция

Агент, которому назначена явная «целевая функция», считается более умным, если он последовательно предпринимает действия, которые успешно максимизируют его запрограммированную целевую функцию. Цель может быть простой («1, если IA выиграет игру в го , 0 в противном случае») или сложной («Выполнить действия, математически похожие на те, которые были успешными в прошлом»). «Целевая функция» включает в себя все цели, ради достижения которых агент стремится действовать; в случае рациональных агентов функция также инкапсулирует приемлемые компромиссы между достижением конфликтующих целей. (Терминология варьируется; например, некоторые агенты стремятся максимизировать или минимизировать « функцию полезности », «целевую функцию» или « функцию потерь ».)

Цели могут быть явно определены или вызваны. Если ИИ запрограммирован на « обучение с подкреплением », у него есть « функция вознаграждения », которая поощряет одни типы поведения и наказывает другие. В качестве альтернативы эволюционная система может побуждать к достижению целей, используя « функцию приспособленности » для мутации и преимущественно репликации систем ИИ с высокими показателями, подобно тому, как животные эволюционировали, чтобы врожденно стремиться к определенным целям, таким как поиск пищи. Некоторые системы искусственного интеллекта, такие как система ближайшего соседа, вместо рассуждений по аналогии, как правило, не ставят цели, за исключением той степени, в которой цели неявно присутствуют в их обучающих данных. Такие системы все еще можно тестировать, если нецелевую систему оформить как систему, «целью» которой является выполнение ее узкой классификационной задачи.

Системы, которые традиционно не считаются агентами, такие как системы представления знаний, иногда включаются в парадигму, представляя их как агентов, цель которых (например) состоит в том, чтобы отвечать на вопросы как можно точнее; понятие «действие» здесь расширено и включает в себя «действие» ответа на вопрос. В качестве дополнительного расширения системы, управляемые мимикрией, могут быть представлены как агенты, оптимизирующие «целевую функцию» в зависимости от того, насколько точно IA преуспевает в имитации желаемого поведения. В генеративных состязательных сетях 2010-х компонент «кодировщик» / «генератор» пытается имитировать и импровизировать композицию человеческого текста. Генератор пытается максимизировать функцию, инкапсулирующую, насколько хорошо он может обмануть антагонистический компонент «предсказатель» / «дискриминатор».

Хотя системы GOFAI часто принимают явную целевую функцию, парадигма также может применяться к нейронным сетям и к эволюционным вычислениям . Обучение с подкреплением может генерировать интеллектуальных агентов, которые действуют таким образом, чтобы максимизировать «функцию вознаграждения». Иногда, вместо того, чтобы устанавливать функцию вознаграждения, которая прямо равна желаемой функции оценки эталонного теста, программисты машинного обучения будут использовать формирование вознаграждения, чтобы изначально вознаграждать машину за постепенный прогресс в обучении. Ян Лекун заявил в 2018 году, что «большинство алгоритмов обучения, которые придумали люди, по сути, состоят в минимизации некоторой целевой функции». У шахмат AlphaZero была простая целевая функция; каждая победа засчитывается как +1 очко, а каждое поражение засчитывается как -1 очко. Целевая функция для беспилотного автомобиля должна быть более сложной. Эволюционные вычисления могут развить интеллектуальных агентов, которые, по-видимому, действуют таким образом, чтобы максимизировать «функцию приспособленности», которая влияет на то, сколько потомков каждому агенту разрешено покинуть.

Теоретическая и невычислимая конструкция AIXI - максимально интеллектуальный агент в этой парадигме; однако в реальном мире IA ограничен конечным временем и аппаратными ресурсами, и ученые соревнуются в создании алгоритмов, которые могут достигать все более высоких результатов в тестовых тестах с реальным оборудованием.

Классы интеллектуальных агентов

Классификация Рассела и Норвига

Рассел и Норвиг (Russell & Norvig, 2003) группируют агентов по пяти классам в зависимости от степени их предполагаемого интеллекта и способностей:

Простые рефлекторные агенты

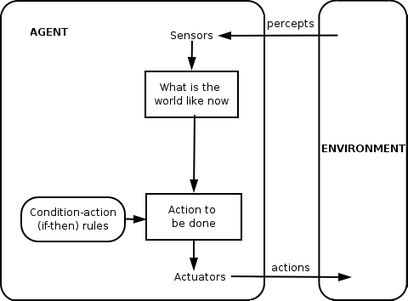

Простые рефлекторные агенты действуют только на основе текущего восприятия, игнорируя остальную часть истории восприятия. Функция агента основана на правиле « условие-действие» : «если условие, то действие».

Эта функция агента выполняется успешно только тогда, когда среда полностью наблюдаема. Некоторые рефлекторные агенты также могут содержать информацию об их текущем состоянии, что позволяет им игнорировать состояния, исполнительные механизмы которых уже сработали.

Бесконечные петли часто неизбежны для простых рефлекторных агентов, действующих в частично наблюдаемой среде. Примечание: если агент может рандомизировать свои действия, возможно, удастся выйти из бесконечных циклов.

Рефлекторные агенты на основе моделей

Агент на основе модели может обрабатывать частично наблюдаемые среды. Его текущее состояние хранится внутри агента, поддерживающего некую структуру, описывающую ту часть мира, которую нельзя увидеть. Это знание о том, «как устроен мир», называется моделью мира, отсюда и название «агент на основе модели».

Рефлекторный агент, основанный на модели, должен поддерживать какую-то внутреннюю модель, которая зависит от истории восприятия и, таким образом, отражает по крайней мере некоторые из ненаблюдаемых аспектов текущего состояния. Историю восприятия и влияние действий на окружающую среду можно определить с помощью внутренней модели. Затем он выбирает действие так же, как рефлекторный агент.

Агент также может использовать модели для описания и прогнозирования поведения других агентов в окружающей среде.

Целевые агенты

Агенты, основанные на целях, дополнительно расширяют возможности агентов на основе моделей за счет использования «целевой» информации. Информация о цели описывает ситуации, которые желательны. Это дает агенту возможность выбирать среди множества возможностей, выбирая ту, которая достигает целевого состояния. Поиск и планирование - это подполя искусственного интеллекта, предназначенные для поиска последовательностей действий, которые достигают целей агента.

Коммунальные агенты

Агенты, основанные на целях, различают только целевые состояния и нецелевые состояния. Также возможно определить меру того, насколько желательно то или иное состояние. Эта мера может быть получена с помощью функции полезности, которая отображает состояние в меру полезности состояния. Более общий показатель эффективности должен позволять сравнивать различные состояния мира в зависимости от того, насколько хорошо они удовлетворяют целям агента. Термин «полезность» можно использовать для описания того, насколько «счастлив» агент.

Агент, основанный на рациональной полезности, выбирает действие, которое максимизирует ожидаемую полезность результатов действия, то есть то, что агент ожидает получить в среднем с учетом вероятностей и полезности каждого результата. Агент на основе утилит должен моделировать и отслеживать свое окружение, задачи, которые потребовали большого количества исследований по восприятию, представлению, рассуждению и обучению.

Обучающие агенты

Преимущество обучения состоит в том, что оно позволяет агентам изначально работать в неизвестной среде и становиться более компетентными, чем могут позволить только их первоначальные знания. Наиболее важное различие заключается между «элементом обучения», который отвечает за внесение улучшений, и «элементом производительности», который отвечает за выбор внешних действий.

Элемент обучения использует обратную связь от «критика» о том, как работает агент, и определяет, как следует изменить элемент производительности или «актера», чтобы добиться лучших результатов в будущем. Элемент производительности - это то, что мы ранее считали агентом в целом: он принимает решения и принимает решения о действиях.

Последний компонент обучающего агента - «генератор проблем». Он отвечает за предложение действий, которые приведут к новому и информативному опыту.

Классификация Вайса

Вайс (2013) определяет четыре класса агентов:

- Агенты на основе логики - в которых решение о том, какое действие выполнить, принимается посредством логической дедукции;

- Реактивные агенты - в которых принятие решений осуществляется в той или иной форме прямого отображения ситуации в действие;

- Агенты убеждения-желания-намерения - в которых принятие решений зависит от манипулирования структурами данных, представляющими убеждения, желания и намерения агента; и наконец,

- Многоуровневые архитектуры - в которых принятие решений реализуется через различные программные уровни, каждый из которых более или менее явно рассуждает о среде на разных уровнях абстракции.

Иерархии агентов

Для активного выполнения своих функций интеллектуальные агенты сегодня обычно собираются в иерархическую структуру, содержащую множество «субагентов». Интеллектуальные субагенты обрабатывают и выполняют функции более низкого уровня. Взятые вместе, интеллектуальный агент и субагенты создают законченную систему, которая может выполнять сложные задачи или цели с поведением и реакциями, которые демонстрируют форму интеллекта.

Как правило, агент может быть сконструирован путем разделения тела на датчики и исполнительные механизмы, чтобы он работал со сложной системой восприятия, которая принимает описание мира в качестве входных данных для контроллера и выдает команды исполнительному механизму. Однако иерархия уровней контроллеров часто необходима для уравновешивания немедленной реакции, необходимой для задач низкого уровня, и медленных рассуждений о сложных целях высокого уровня.

Функция агента

Простая программа агента может быть определена математически как функция f (называемая «функцией агента»), которая отображает каждую возможную последовательность восприятий на возможное действие, которое может выполнить агент, или на коэффициент, элемент обратной связи, функцию или константу, которая влияет на конечные действия:

Функция агента - это абстрактное понятие, так как оно может включать в себя различные принципы принятия решений, такие как расчет полезности отдельных вариантов, дедукция по логическим правилам, нечеткая логика и т. Д.

Агент программы , вместо этого, отображает все возможные перцепции к действию.

Мы используем термин «восприятие» для обозначения восприятий, поступающих от агента в любой данный момент. На следующих рисунках агент - это все, что можно рассматривать как воспринимающее среду с помощью датчиков и воздействующее на нее с помощью исполнительных механизмов.

Приложения

Интеллектуальные агенты применяются в качестве автоматизированных онлайн-помощников , где они функционируют, чтобы воспринимать потребности клиентов с целью индивидуального обслуживания клиентов . Такой агент может в основном состоять из диалоговой системы , аватара , а также экспертной системы для предоставления пользователю определенных знаний. Их также можно использовать для оптимизации координации групп людей в сети. Hallerbach et al. обсудили применение агентных подходов для разработки и проверки автоматизированных систем вождения с помощью цифрового двойника тестируемого транспортного средства и микроскопического моделирования дорожного движения на основе независимых агентов. Waymo создала среду мультиагентного моделирования Carcraft для тестирования алгоритмов беспилотных автомобилей . Он имитирует дорожное взаимодействие между водителями-людьми, пешеходами и автоматизированными транспортными средствами. Поведение людей имитируется искусственными агентами на основе данных реального человеческого поведения. Основная идея использования агентного моделирования для понимания беспилотных автомобилей обсуждалась еще в 2003 году.

Альтернативные определения и использования

«Интеллектуальный агент» также часто используется в качестве расплывчатого маркетингового термина, иногда синонима « виртуального личного помощника ». Некоторые определения 20-го века характеризуют агента как программу, которая помогает пользователю или действует от имени пользователя. Эти примеры известны как программные агенты , а иногда «интеллектуальный программный агент» (то есть программный агент с интеллектом) упоминается как «интеллектуальный агент».

По словам Николы Касабова, системы ИА должны обладать следующими характеристиками:

- Постепенно приспосабливайте новые правила решения проблем

- Адаптация онлайн и в реальном времени

- Умеют анализировать себя с точки зрения поведения, ошибок и успеха.

- Учиться и совершенствоваться через взаимодействие с окружающей средой ( воплощение )

- Быстро учиться на больших объемах данных

- Иметь возможности для хранения и извлечения образцов на основе памяти

- Имеют параметры для представления кратковременной и долговременной памяти, возраста, забывания и т. Д.

Смотрите также

- Программный агент

- Когнитивные архитектуры

- Когнитивное радио - практическое поле для реализации

- Кибернетика , Информатика

- Агент интеллектуального анализа данных

- Воплощенный агент

- Федеративный поиск - способность агентов искать разнородные источники данных с использованием единого словаря.

- Нечеткие агенты - IA с адаптивной нечеткой логикой

- Язык программирования агента GOAL

- Интеллект

- Интеллектуальная система

- ДЖЕК Интеллектуальные агенты

- Многоагентная система и многоагентная система - несколько интерактивных агентов

- Классификация PEAS среды агента

- Обучение с подкреплением

- Семантическая сеть - предоставление данных в Интернете для автоматической обработки агентами.

- Смоделированная реальность

- Социальная симуляция

- Эра интеллектуальных агентов

Примечания

Встроенные ссылки

Другие ссылки

- Домингос, Педро (22 сентября 2015 г.). Главный алгоритм: как поиски совершенной обучающей машины переделают наш мир . Основные книги . ISBN 978-0465065707.

- Рассел, Стюарт Дж .; Норвиг, Питер (2003). Искусственный интеллект: современный подход (2-е изд.). Река Аппер Сэдл, Нью-Джерси: Prentice Hall. Глава 2. ISBN 0-13-790395-2.

- Касабов, Н. (1998). «Введение: гибридные интеллектуальные адаптивные системы». Международный журнал интеллектуальных систем . 13 (6): 453–454. DOI : 10.1002 / (SICI) 1098-111X (199806) 13: 6 <453 :: AID-INT1> 3.0.CO; 2-K .

- Вайс, Г. (2013). Мультиагентные системы (2-е изд.). Кембридж, Массачусетс: MIT Press. ISBN 978-0-262-01889-0.