Искусственный интеллект -Artificial intelligence

| Часть серии о |

| Искусственный интеллект |

|---|

Искусственный интеллект ( ИИ ) — это интеллект , демонстрируемый машинами , в отличие от естественного интеллекта , демонстрируемого животными , включая людей . Исследования ИИ были определены как область изучения интеллектуальных агентов , которая относится к любой системе, которая воспринимает окружающую среду и предпринимает действия, которые максимизируют ее шансы на достижение своих целей.

Термин «искусственный интеллект» ранее использовался для описания машин, которые имитируют и демонстрируют «человеческие» когнитивные навыки, связанные с человеческим разумом , такие как «обучение» и «решение проблем». С тех пор это определение было отвергнуто крупными исследователями ИИ, которые теперь описывают ИИ с точки зрения рациональности и рационального действия, что не ограничивает то, как можно сформулировать интеллект.

Приложения ИИ включают передовые поисковые системы в Интернете (например, Google ), системы рекомендаций (используемые YouTube , Amazon и Netflix ), понимание человеческой речи (например, Siri и Alexa ), беспилотные автомобили (например, Tesla ), автоматизированное принятие решений. и соревноваться на самом высоком уровне в стратегических игровых системах (таких как шахматы и го ). По мере того, как машины становятся все более способными, задачи, которые, как считается, требуют «интеллекта», часто исключаются из определения ИИ, явление, известное как эффект ИИ . Например, оптическое распознавание символов часто исключается из того, что считается ИИ, став рутинной технологией.

Искусственный интеллект был основан как академическая дисциплина в 1956 году и с тех пор пережил несколько волн оптимизма, за которыми последовали разочарование и потеря финансирования (известная как « зима ИИ »), за которыми последовали новые подходы, успех и возобновление финансирования. . С момента своего основания исследования ИИ пробовали и отвергали множество различных подходов, включая моделирование мозга, моделирование решения проблем человека , формальную логику , большие базы данных знаний и имитацию поведения животных. В первые десятилетия 21-го века в этой области доминировало математическо-статистическое машинное обучение , и этот метод оказался очень успешным, помогая решать многие сложные проблемы в промышленности и научных кругах.

Различные подобласти исследований ИИ сосредоточены вокруг конкретных целей и использования определенных инструментов. Традиционные цели исследований ИИ включают рассуждение , представление знаний , планирование , обучение , обработку естественного языка , восприятие и способность перемещать объекты и манипулировать ими. Общий интеллект (способность решать произвольные задачи) является одной из долгосрочных целей в этой области. Для решения этих проблем исследователи ИИ адаптировали и интегрировали широкий спектр методов решения проблем, включая поиск и математическую оптимизацию, формальную логику, искусственные нейронные сети и методы, основанные на статистике , вероятности и экономике . ИИ также опирается на информатику , психологию , лингвистику , философию и многие другие области.

Эта область была основана на предположении, что человеческий интеллект «можно описать настолько точно, что можно создать машину для его моделирования». Это вызвало философские споры о разуме и этических последствиях создания искусственных существ, наделенных интеллектом, подобным человеческому; эти вопросы ранее исследовались мифами , художественной литературой и философией с древних времен. Ученые- компьютерщики и философы с тех пор предположили, что ИИ может стать экзистенциальным риском для человечества, если его рациональные способности не будут направлены на полезные цели.

История

Вымыслы и ранние концепции

Искусственные существа с интеллектом появились в качестве средств повествования в древности и были обычным явлением в художественной литературе, например, в « Франкенштейне » Мэри Шелли или « RUR » Карела Чапека . Эти персонажи и их судьбы поднимали многие из тех же вопросов, которые сейчас обсуждаются в этике искусственного интеллекта. .

Изучение механических или «формальных» рассуждений началось с философов и математиков в древности. Изучение математической логики привело непосредственно к теории вычислений Алана Тьюринга , которая предполагала, что машина, перетасовывая такие простые символы, как «0» и «1», может имитировать любой мыслимый акт математической дедукции. Это понимание того, что цифровые компьютеры могут моделировать любой процесс формальных рассуждений, известно как тезис Черча-Тьюринга .

Тезис Черча-Тьюринга, наряду с одновременными открытиями в нейробиологии , теории информации и кибернетике , побудил исследователей рассмотреть возможность создания электронного мозга. Первой работой, которая в настоящее время общепризнанна как ИИ, был формальный дизайн Маккалуша и Питтса 1943 года для полных по Тьюрингу «искусственных нейронов».

Ранние исследования

К 1950-м годам появилось два взгляда на то, как добиться машинного интеллекта. Одно видение, известное как Symbolic AI или GOFAI , заключалось в том, чтобы использовать компьютеры для создания символического представления мира и систем, которые могли бы рассуждать о мире. Среди сторонников были Аллен Ньюэлл , Герберт А. Саймон и Марвин Мински . С этим подходом был тесно связан подход «эвристического поиска» , который уподоблял интеллект проблеме исследования пространства возможностей для ответов. Второе видение, известное как коннекционистский подход , стремилось достичь интеллекта посредством обучения. Сторонники этого подхода, в первую очередь Фрэнк Розенблатт , стремились соединить персептрон способами, вдохновленными связями нейронов. Джеймс Маньика и другие сравнили два подхода к разуму (символический ИИ) и мозгу (коннекционист). Маника утверждает, что символические подходы доминировали в продвижении искусственного интеллекта в этот период, отчасти из-за его связи с интеллектуальными традициями Декарта , Буля , Готлоба Фреге , Бертрана Рассела и других. Коннекционистские подходы, основанные на кибернетике или искусственных нейронных сетях , были отодвинуты на задний план, но в последние десятилетия получили новое распространение.

Направление исследований ИИ зародилось на семинаре в Дартмутском колледже в 1956 году. Его участники стали основателями и лидерами исследований ИИ. Они и их ученики создавали программы, которые пресса назвала «поразительными»: компьютеры изучали стратегии игры в шашки , решали текстовые задачи по алгебре, доказывали логические теоремы и говорили по-английски. К середине 1960-х годов исследования в США в значительной степени финансировались Министерством обороны , и по всему миру были созданы лаборатории.

Исследователи 1960-х и 1970-х годов были убеждены, что символические подходы в конечном итоге приведут к успеху в создании машины с искусственным общим интеллектом , и считали это целью своей области. Герберт Саймон предсказал, что «в течение двадцати лет машины будут способны выполнять любую работу, которую может выполнять человек». Марвин Мински согласился, написав: «В течение поколения ... проблема создания« искусственного интеллекта »в значительной степени будет решена».

Они не смогли осознать сложность некоторых оставшихся задач. Прогресс замедлился, и в 1974 году в ответ на критику сэра Джеймса Лайтхилла и продолжающееся давление со стороны Конгресса США с целью финансирования более продуктивных проектов правительства США и Великобритании прекратили исследовательские исследования в области ИИ. Следующие несколько лет позже назовут « зимой ИИ », периодом, когда получение финансирования для проектов ИИ было затруднено.

От экспертных систем к машинному обучению

В начале 1980-х исследования ИИ были возрождены благодаря коммерческому успеху экспертных систем , формы программы ИИ, которая имитировала знания и аналитические навыки экспертов-людей. К 1985 году рынок ИИ превысил миллиард долларов. В то же время японский компьютерный проект пятого поколения вдохновил правительства США и Великобритании на восстановление финансирования академических исследований . Однако, начиная с краха рынка Lisp Machine в 1987 году, ИИ снова потерял репутацию, и началась вторая, более продолжительная зима.

Многие исследователи начали сомневаться в том, что символический подход сможет имитировать все процессы человеческого познания, особенно восприятие , робототехнику, обучение и распознавание образов . Ряд исследователей начали изучать «субсимволические» подходы к конкретным проблемам ИИ. Исследователи робототехники , такие как Родни Брукс , отвергли символический ИИ и сосредоточились на основных инженерных проблемах, которые позволили бы роботам двигаться, выживать и изучать окружающую среду. Интерес к нейронным сетям и « коннекционизму » возродили Джеффри Хинтон , Дэвид Румельхарт и другие в середине 1980-х годов. Инструменты мягких вычислений были разработаны в 80-х годах, такие как нейронные сети , нечеткие системы , теория систем Грея , эволюционные вычисления и многие инструменты, основанные на статистике или математической оптимизации .

ИИ постепенно восстанавливал свою репутацию в конце 1990-х и начале 21 века, находя конкретные решения конкретных проблем. Узкая направленность позволила исследователям получать поддающиеся проверке результаты, использовать больше математических методов и сотрудничать с другими областями (такими как статистика , экономика и математика ). К 2000 году решения, разработанные исследователями ИИ, получили широкое распространение, хотя в 1990-х их редко называли «искусственным интеллектом».

Более быстрые компьютеры , усовершенствования алгоритмов и доступ к большим объемам данных позволили добиться прогресса в машинном обучении и восприятии; примерно в 2012 году методы глубокого обучения , требовательные к данным, стали доминировать в тестах точности . По словам Джека Кларка из Bloomberg , 2015 год стал знаковым для искусственного интеллекта: количество программных проектов, использующих ИИ в Google , увеличилось с «спорадического использования» в 2012 году до более чем 2700 проектов. Он объясняет это увеличением количества доступных нейронных сетей из-за роста инфраструктуры облачных вычислений и увеличения количества исследовательских инструментов и наборов данных. В опросе 2017 года каждая пятая компания сообщила, что они «включили ИИ в некоторые предложения или процессы». Количество исследований в области ИИ (измеряемое по общему количеству публикаций) увеличилось на 50% в 2015–2019 годах.

Многие академические исследователи были обеспокоены тем, что ИИ больше не преследует первоначальную цель создания универсальных, полностью интеллектуальных машин. Большая часть текущих исследований связана со статистическим ИИ, который в подавляющем большинстве случаев используется для решения конкретных задач, даже в очень успешных методах, таких как глубокое обучение . Эта озабоченность привела к созданию области искусственного общего интеллекта (или «AGI»), в которой к 2010-м годам было несколько хорошо финансируемых учреждений.

Цели

Общая проблема моделирования (или создания) интеллекта разбита на подзадачи. Они состоят из определенных черт или возможностей, которые исследователи ожидают от интеллектуальной системы. Черты, описанные ниже, привлекли наибольшее внимание.

Рассуждение, решение проблем

Ранние исследователи разработали алгоритмы, имитирующие пошаговые рассуждения, которые люди используют, когда решают головоломки или делают логические выводы. К концу 1980-х и 1990-х в исследованиях ИИ были разработаны методы работы с сомнительной или неполной информацией с использованием концепций вероятности и экономики .

Многие из этих алгоритмов оказались недостаточными для решения больших логических задач, потому что они испытали «комбинаторный взрыв»: они становились экспоненциально медленнее по мере роста задач. Даже люди редко используют пошаговую дедукцию, которую могли смоделировать ранние исследования ИИ. Они решают большинство своих проблем, используя быстрые, интуитивные суждения.

Представление знаний

Представление знаний и инженерия знаний позволяют программам ИИ разумно отвечать на вопросы и делать выводы о реальных фактах.

Представление «того, что существует» — это онтология : набор объектов, отношений, понятий и свойств, формально описанных так, чтобы программные агенты могли их интерпретировать. Наиболее общие онтологии называются верхними онтологиями , которые пытаются обеспечить основу для всех других знаний и действуют как посредники между онтологиями предметной области , которые охватывают конкретные знания о конкретной предметной области (области интереса или области интереса). По-настоящему разумной программе также потребуется доступ к знаниям здравого смысла; совокупность фактов, известных среднему человеку. Семантика онтологии обычно представлена в логике описания, такой как язык веб-онтологий .

В исследованиях ИИ были разработаны инструменты для представления конкретных областей, таких как объекты, свойства, категории и отношения между объектами; ситуации, события, состояния и время; причины и следствия; знание о знании (что мы знаем о том, что знают другие люди); рассуждения по умолчанию (вещи, которые люди считают истинными, пока им не говорят по-другому, и останутся верными, даже когда другие факты меняются); а также другие домены. Среди самых сложных проблем в ИИ: широта знаний здравого смысла (количество атомарных фактов, которые знает средний человек, огромно); и субсимволическая форма наиболее здравого знания (многое из того, что люди знают, не представлено в виде «фактов» или «утверждений», которые они могли бы выразить устно).

Формальные представления знаний используются при индексировании и поиске на основе содержимого, интерпретации сцен, поддержке принятия клинических решений, обнаружении знаний (извлечении «интересных» и действенных выводов из больших баз данных) и других областях.

Планирование

Интеллектуальный агент, который может планировать , создает представление о состоянии мира, делает прогнозы о том, как его действия изменят его, и делает выбор, который максимизирует полезность (или «ценность») доступных вариантов. В классических задачах планирования агент может предположить, что это единственная действующая в мире система, позволяющая агенту быть уверенным в последствиях своих действий. Однако, если агент не является единственным действующим лицом, то требуется, чтобы агент рассуждал в условиях неопределенности, постоянно переоценивал свое окружение и адаптировался. Многоагентное планирование использует сотрудничество и конкуренцию многих агентов для достижения поставленной цели. Эмерджентное поведение , подобное этому, используется эволюционными алгоритмами и роевым интеллектом .

Обучение

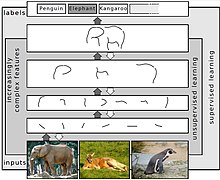

Машинное обучение (ML), фундаментальная концепция исследований ИИ с момента зарождения этой области, представляет собой изучение компьютерных алгоритмов, которые автоматически улучшаются благодаря опыту.

Неконтролируемое обучение находит закономерности в потоке ввода. Обучение под наблюдением требует, чтобы человек сначала маркировал входные данные, и бывает двух основных разновидностей: классификация и численная регрессия . Классификация используется для определения того, к какой категории что-то относится — программа видит ряд примеров вещей из нескольких категорий и учится классифицировать новые входные данные. Регрессия — это попытка создать функцию, которая описывает взаимосвязь между входными и выходными данными и предсказывает, как должны изменяться выходные данные при изменении входных данных. И классификаторы, и регрессионные обучающиеся могут рассматриваться как «аппроксиматоры функций», пытающиеся изучить неизвестную (возможно, неявную) функцию; например, классификатор спама можно рассматривать как изучение функции, которая отображает текст электронного письма в одну из двух категорий: «спам» или «не спам». При обучении с подкреплением агент вознаграждается за хорошие ответы и наказывается за плохие. Агент классифицирует свои ответы, чтобы сформировать стратегию работы в своем проблемном пространстве. Трансферное обучение — это когда знания, полученные при решении одной проблемы, применяются для решения новой проблемы.

Теория компьютерного обучения может оценивать учащихся по вычислительной сложности , по сложности выборки (сколько данных требуется) или по другим понятиям оптимизации .

Обработка естественного языка

Обработка естественного языка (NLP) позволяет машинам читать и понимать человеческий язык. Достаточно мощная система обработки естественного языка позволила бы использовать пользовательские интерфейсы на естественном языке и получать знания непосредственно из письменных источников, таких как тексты новостных лент. Некоторые простые применения НЛП включают поиск информации , ответы на вопросы и машинный перевод .

Символический ИИ использовал формальный синтаксис для перевода глубокой структуры предложений в логику . Это не привело к полезным приложениям из-за неподатливости логики и широты знаний здравого смысла. Современные статистические методы включают частоту совпадений (как часто одно слово появляется рядом с другим), «обнаружение ключевых слов» (поиск определенного слова для получения информации), глубокое обучение на основе преобразователя (которое находит закономерности в тексте) и другие. Они достигли приемлемой точности на уровне страницы или абзаца и к 2019 году могли генерировать связный текст.

Восприятие

Восприятие машины — это способность использовать входные данные от датчиков (таких как камеры, микрофоны, беспроводные сигналы и активные лидары , гидролокаторы, радары и тактильные датчики ) для определения аспектов мира. Приложения включают распознавание речи , распознавание лиц и распознавание объектов . Компьютерное зрение — это способность анализировать визуальный ввод.

Движение и манипуляция

ИИ активно используется в робототехнике. Локализация — это то, как робот узнает свое местоположение и наносит на карту свое окружение. При наличии небольшого статического и видимого окружения это легко сделать; однако динамическая среда, такая как (в эндоскопии ) внутренняя часть дышащего тела пациента, представляет большую проблему.

Планирование движения — это процесс разбиения двигательной задачи на «примитивы», такие как движения отдельных суставов. Такое движение часто включает податливое движение, процесс, при котором движение требует поддержания физического контакта с объектом. Роботы могут на собственном опыте научиться эффективно двигаться, несмотря на трение и проскальзывание передач.

Социальный интеллект

Аффективные вычисления — это междисциплинарный зонтик, включающий системы, которые распознают, интерпретируют, обрабатывают или моделируют человеческие чувства, эмоции и настроение . Например, некоторые виртуальные помощники запрограммированы на разговорную речь или даже на юмористические подшучивания; это делает их более чувствительными к эмоциональной динамике человеческого взаимодействия или иным образом облегчает взаимодействие человека с компьютером . Однако это, как правило, дает наивным пользователям нереалистичное представление о том, насколько интеллектуальными на самом деле являются существующие компьютерные агенты. Умеренные успехи, связанные с аффективными вычислениями, включают анализ текстовых настроений и, в последнее время, мультимодальный анализ настроений ), в котором ИИ классифицирует аффекты, отображаемые субъектом, записанным на видео.

Общий интеллект

Машина с общим интеллектом может решать широкий спектр задач с широтой и универсальностью, аналогичной человеческому интеллекту. Существует несколько конкурирующих идей о том, как развивать искусственный общий интеллект. Ханс Моравек и Марвин Мински утверждают, что работа в различных отдельных областях может быть включена в продвинутую многоагентную систему или когнитивную архитектуру с общим интеллектом. Педро Домингос надеется, что существует концептуально простой, но математически сложный « главный алгоритм », который может привести к ОИИ. Другие полагают, что антропоморфные особенности, такие как искусственный мозг или симуляция развития ребенка , когда-нибудь достигнут критической точки, когда появится общий интеллект .

Инструменты

Поиск и оптимизация

Многие проблемы в ИИ могут быть решены теоретически путем интеллектуального поиска множества возможных решений: Рассуждение может быть сведено к выполнению поиска. Например, логическое доказательство можно рассматривать как поиск пути, который ведет от предпосылок к выводам , где каждый шаг представляет собой применение правила вывода . Алгоритмы планирования просматривают деревья целей и подцелей, пытаясь найти путь к целевой цели, этот процесс называется анализом средств и целей . Алгоритмы робототехники для перемещения конечностей и захвата объектов используют локальный поиск в конфигурационном пространстве .

Простых исчерпывающих переборов редко бывает достаточно для решения большинства реальных проблем: пространство поиска (количество мест для поиска) быстро растет до астрономических чисел . В результате поиск выполняется слишком медленно или никогда не завершается. Решением многих проблем является использование « эвристик » или «эмпирических правил», которые расставляют приоритеты в пользу тех, кто с большей вероятностью достигнет цели и сделает это за меньшее количество шагов. В некоторых методологиях поиска эвристика также может служить для устранения некоторых вариантов выбора, которые вряд ли приведут к цели (так называемая « подрезка дерева поиска »). Эвристика снабжает программу «наилучшей догадкой» о пути, на котором лежит решение. Эвристика ограничивает поиск решений меньшим размером выборки.

В 1990-х годах стал известен совсем другой вид поиска, основанный на математической теории оптимизации . Для многих задач можно начать поиск с какой-либо догадки, а затем постепенно уточнять догадку до тех пор, пока дальнейшие уточнения не могут быть сделаны. Эти алгоритмы можно визуализировать как восхождение вслепую : мы начинаем поиск в случайной точке ландшафта, а затем прыжками или шагами продолжаем продвигать нашу догадку в гору, пока не достигнем вершины. Другие связанные алгоритмы оптимизации включают случайную оптимизацию , поиск луча и метаэвристику , такую как имитация отжига . Эволюционные вычисления используют форму поиска оптимизации. Например, они могут начать с популяции организмов (предположения), а затем позволить им мутировать и рекомбинировать, выбирая только наиболее приспособленных для выживания в каждом поколении (уточнение предположений). Классические эволюционные алгоритмы включают генетические алгоритмы , программирование экспрессии генов и генетическое программирование . В качестве альтернативы распределенные процессы поиска могут координироваться с помощью алгоритмов группового интеллекта . Двумя популярными алгоритмами роя, используемыми в поиске, являются оптимизация роя частиц (вдохновленная стайкой птиц ) и оптимизация муравьиной колонии (вдохновленная муравьиными следами ).

Логика

Логика используется для представления знаний и решения проблем, но ее можно применять и к другим проблемам. Например, алгоритм сатплана использует логику для планирования , а индуктивное логическое программирование является методом обучения .

В исследованиях ИИ используется несколько различных форм логики. Логика высказываний включает такие функции истинности , как «или» и «не». Логика первого порядка добавляет кванторы и предикаты и может выражать факты об объектах, их свойствах и их отношениях друг с другом. Нечеткая логика присваивает «степень истины» (от 0 до 1) расплывчатым утверждениям, таким как «Алиса старая» (или богатая, или высокая, или голодная), которые слишком лингвистически неточны, чтобы быть полностью истинными или ложными. Логика по умолчанию , немонотонная логика и ограничение — это формы логики, предназначенные для помощи в рассуждениях по умолчанию и проблеме квалификации . Несколько расширений логики были разработаны для работы с конкретными областями знаний , такими как логика описания ; исчисление ситуаций , исчисление событий и беглое исчисление (для представления событий и времени); причинное исчисление ; исчисление убеждений (пересмотр убеждений) ; и модальная логика . Также были разработаны логики для моделирования противоречивых или несогласованных утверждений, возникающих в многоагентных системах, например, паранепротиворечивые логики .

Вероятностные методы неопределенных рассуждений

Многие проблемы в ИИ (в том числе в рассуждениях, планировании, обучении, восприятии и робототехнике) требуют, чтобы агент работал с неполной или неточной информацией. Исследователи ИИ разработали ряд инструментов для решения этих проблем, используя методы теории вероятностей и экономики. Байесовские сети — очень общий инструмент, который можно использовать для решения различных задач, включая рассуждение (с использованием байесовского алгоритма вывода), обучение (с использованием алгоритма максимизации ожидания ), планирование (с использованием сетей принятия решений ) и восприятие (с использованием динамических байесовских сетей ). Вероятностные алгоритмы также можно использовать для фильтрации, предсказания, сглаживания и поиска объяснений потоков данных, помогая системам восприятия анализировать процессы, происходящие во времени (например, скрытые модели Маркова или фильтры Калмана ).

Ключевым понятием экономической науки является « полезность », мера того, насколько что-то ценно для разумного агента. Были разработаны точные математические инструменты, которые анализируют, как агент может делать выбор и планировать, используя теорию принятия решений , анализ решений и теорию ценности информации. Эти инструменты включают такие модели, как марковские процессы принятия решений , динамические сети принятия решений , теория игр и проектирование механизмов .

Классификаторы и статистические методы обучения

Простейшие ИИ-приложения можно разделить на два типа: классификаторы («если блестит, то алмаз») и контроллеры («если алмаз, то подбирай»). Однако контроллеры также классифицируют условия перед выводом действий, и поэтому классификация составляет центральную часть многих систем ИИ. Классификаторы — это функции, которые используют сопоставление с образцом для определения ближайшего совпадения. Их можно настраивать по примерам, что делает их очень привлекательными для использования в ИИ. Эти примеры известны как наблюдения или закономерности. В обучении с учителем каждый шаблон принадлежит к определенному заранее определенному классу. Класс – это решение, которое нужно принять. Все наблюдения в сочетании с их метками классов называются набором данных. Когда получено новое наблюдение, это наблюдение классифицируется на основе предыдущего опыта.

Классификатор можно обучать различными способами; существует множество статистических и машинных подходов к обучению. Дерево решений — это простейший и наиболее широко используемый алгоритм символьного машинного обучения. Алгоритм K-ближайшего соседа был наиболее широко используемым аналоговым ИИ до середины 1990-х годов. Методы ядра, такие как машина опорных векторов (SVM), вытеснили k-ближайшего соседа в 1990-х годах. Сообщается , что наивный байесовский классификатор является «наиболее широко используемым обучающим устройством» в Google, отчасти благодаря его масштабируемости. Нейронные сети также используются для классификации.

Производительность классификатора сильно зависит от характеристик классифицируемых данных, таких как размер набора данных, распределение выборок по классам, размерность и уровень шума. Классификаторы на основе моделей работают хорошо, если предполагаемая модель очень хорошо подходит для фактических данных. В противном случае, если нет доступной модели сопоставления и если единственной заботой является точность (а не скорость или масштабируемость), общепринятое мнение состоит в том, что дискриминационные классификаторы (особенно SVM), как правило, более точны, чем классификаторы на основе моделей, такие как «наивный байесовский метод». на большинстве практических наборов данных.

Искусственные нейронные сети

Нейронные сети были вдохновлены архитектурой нейронов человеческого мозга. Простой «нейрон» N принимает входные данные от других нейронов, каждый из которых при активации (или «запуске») подает взвешенный «голос» за или против того, должен ли нейрон N активироваться сам. Для обучения требуется алгоритм для корректировки этих весов на основе обучающих данных; один простой алгоритм (названный « зажигаем вместе, соединяем вместе ») заключается в увеличении веса между двумя соединенными нейронами, когда активация одного вызывает успешную активацию другого. Нейроны имеют непрерывный спектр активации; кроме того, нейроны могут обрабатывать входные данные нелинейным образом, а не просто взвешивать голоса.

Современные нейронные сети моделируют сложные отношения между входными и выходными данными и находят закономерности в данных. Они могут изучать непрерывные функции и даже цифровые логические операции. Нейронные сети можно рассматривать как тип математической оптимизации — они выполняют градиентный спуск по многомерной топологии, созданной путем обучения сети. Наиболее распространенным методом обучения является алгоритм обратного распространения ошибки . Другими методами обучения для нейронных сетей являются обучение по Хеббу («вместе запускаем, соединяем вместе»), GMDH или конкурентное обучение .

Основными категориями сетей являются ациклические нейронные сети или нейронные сети с прямой связью (где сигнал проходит только в одном направлении) и рекуррентные нейронные сети (которые допускают обратную связь и кратковременную память о предыдущих входных событиях). Среди наиболее популярных сетей прямого распространения — персептроны , многослойные персептроны и радиальные базисные сети .

Глубокое обучение

Глубокое обучение использует несколько слоев нейронов между входами и выходами сети. Несколько слоев могут постепенно извлекать функции более высокого уровня из необработанных входных данных. Например, при обработке изображений нижние уровни могут идентифицировать края, а более высокие уровни могут идентифицировать понятия, относящиеся к человеку, такие как цифры, буквы или лица. Глубокое обучение резко улучшило производительность программ во многих важных областях искусственного интеллекта, включая компьютерное зрение , распознавание речи , классификацию изображений и другие.

Глубокое обучение часто использует сверточные нейронные сети для многих или всех своих слоев. В сверточном слое каждый нейрон получает входные данные только из ограниченной области предыдущего слоя, называемой рецептивным полем нейрона . Это может существенно уменьшить количество взвешенных связей между нейронами и создать иерархию, подобную организации зрительной коры животных.

В рекуррентной нейронной сети сигнал будет проходить через слой более одного раза; таким образом, RNN является примером глубокого обучения. RNN можно обучать с помощью градиентного спуска , однако долгосрочные градиенты, которые распространяются обратно, могут «исчезнуть» (то есть они могут стремиться к нулю) или «взорваться» (то есть они могут стремиться к бесконечности), известные как проблема исчезающего градиента . Техника долговременной кратковременной памяти (LSTM) может предотвратить это в большинстве случаев.

Специализированные языки и оборудование

Разработаны специализированные языки для искусственного интеллекта, такие как Lisp , Prolog , TensorFlow и многие другие. Аппаратное обеспечение, разработанное для ИИ, включает ускорители ИИ и нейроморфные вычисления .

Приложения

ИИ актуален для любой интеллектуальной задачи. Современные методы искусственного интеллекта широко распространены, и их слишком много, чтобы перечислять их здесь. Часто, когда техника становится широко используемой, она больше не считается искусственным интеллектом; это явление описывается как эффект ИИ .

В 2010-х приложения ИИ лежали в основе наиболее коммерчески успешных областей вычислений и стали повсеместной частью повседневной жизни. ИИ используется в поисковых системах (таких как Google Search ), таргетинге онлайн-рекламы , системах рекомендаций (предлагаемых Netflix , YouTube или Amazon ), управлении интернет-трафиком , целевой рекламе ( AdSense , Facebook ), виртуальных помощниках (таких как Siri или Alexa ) . , автономные транспортные средства (включая дроны и беспилотные автомобили ), автоматический языковой перевод ( Microsoft Translator , Google Translate ), распознавание лиц ( Apple Face ID или Microsoft DeepFace ), маркировка изображений ( используется Facebook , Apple iPhoto и TikTok ) и фильтрацию спама .

Существуют также тысячи успешных приложений ИИ, используемых для решения проблем в конкретных отраслях или учреждениях. Вот несколько примеров: хранение энергии , дипфейки , медицинская диагностика, военная логистика или управление цепочками поставок.

Игра была проверкой силы ИИ с 1950-х годов. Deep Blue стала первой компьютерной шахматной системой , которая 11 мая 1997 года обыграла действующего чемпиона мира по шахматам Гарри Каспарова . В 2011 году In a Jeopardy! выставочный матч викторины , система ответов на вопросы от IBM , Watson , победила два величайших Jeopardy! чемпионы, Брэд Раттер и Кен Дженнингс , со значительным отрывом. В марте 2016 года AlphaGo выиграла 4 из 5 партий в го в матче с чемпионом по го Ли Седолем , став первой компьютерной системой для игры в го, обыгравшей профессионального игрока в го без форы . Другие программы обрабатывают игры с несовершенной информацией ; например для покера на сверхчеловеческом уровне, Pluribus и Cepheus . DeepMind в 2010-х разработала «обобщенный искусственный интеллект», который мог самостоятельно изучать множество разнообразных игр Atari .

К 2020 году системы обработки естественного языка , такие как огромный GPT-3 (на тот момент крупнейшая искусственная нейронная сеть), соответствовали человеческой производительности на ранее существовавших тестах, хотя система не достигла понимания здравого смысла содержания тестов. AlphaFold 2 (2020 г.) DeepMind продемонстрировал способность аппроксимировать трехмерную структуру белка за часы, а не за месяцы. Другие приложения предсказывают результат судебных решений, создают искусство (например, поэзию или живопись) и доказывают математические теоремы .

В 2019 г. ВОИС сообщила, что ИИ является самой популярной новой технологией с точки зрения количества патентных заявок и выданных патентов, а Интернет вещей , по оценкам, является крупнейшим с точки зрения размера рынка. За ним последовали, опять же по размеру рынка, технологии больших данных, робототехника, искусственный интеллект, 3D-печать и пятое поколение мобильных услуг (5G). С момента появления ИИ в 1950-х годах новаторы подали 340 000 патентных заявок, связанных с ИИ, и исследователи опубликовали 1,6 миллиона научных статей, при этом большая часть всех патентных заявок, связанных с ИИ, была опубликована с 2013 года. Компании представляют 26 из 30 крупнейших компаний. заявители на патент ИИ, а остальные четыре составляют университеты или государственные исследовательские организации. Соотношение научных работ и изобретений значительно снизилось с 8:1 в 2010 г. до 3:1 в 2016 г., что свидетельствует о переходе от теоретических исследований к использованию технологий ИИ в коммерческих продуктах и услугах. Машинное обучение является доминирующим методом ИИ, раскрытым в патентах, и включено в более чем одну треть всех выявленных изобретений (134777 патентов на машинное обучение, поданных в общей сложности 167038 патентов на ИИ, поданных в 2016 г.), при этом компьютерное зрение является наиболее популярным функциональным приложением. . Патенты, связанные с ИИ, не только раскрывают методы и приложения ИИ, они часто также относятся к области применения или отрасли. В 2016 году было определено 20 областей применения, которые в порядке значимости включали: телекоммуникации (15 процентов), транспорт (15 процентов), биологические и медицинские науки (12 процентов) и персональные устройства, вычислительную технику и взаимодействие человека с компьютером (11 процентов). . Другие сектора включали банковское дело, развлечения, безопасность, промышленность и производство, сельское хозяйство и сети (включая социальные сети, умные города и Интернет вещей). IBM имеет самый большой портфель патентов в области ИИ с 8 290 патентными заявками, за ней следует Microsoft с 5 930 патентными заявками.

Правовые аспекты

Способность ИИ принимать решения поднимает вопросы юридической ответственности и авторского статуса созданных произведений. Эти вопросы уточняются в различных юрисдикциях.

Философия

Определение искусственного интеллекта

Мышление против действия: тест Тьюринга

Алан Тьюринг писал в 1950 году: «Я предлагаю рассмотреть вопрос «могут ли машины думать»?» Он посоветовал изменить вопрос с «думает ли машина» на «возможно ли, чтобы машина продемонстрировала разумное поведение». Единственная видимая вещь — это поведение машины, поэтому не имеет значения, сознательна ли машина , или имеет разум , или является ли интеллект просто «симуляцией», а не «реальной вещью». Он отметил, что мы также не знаем этих вещей о других людях, но мы расширяем «вежливое соглашение», что они на самом деле «думают». Эта идея лежит в основе теста Тьюринга.

Действовать по-человечески против действовать разумно: интеллектуальные агенты

Основатель ИИ Джон Маккарти сказал: «Искусственный интеллект по определению не является симуляцией человеческого интеллекта». Рассел и Норвиг соглашаются и критикуют тест Тьюринга. Они писали: « Тексты по авиационной инженерии не определяют цель своей области как создание «машин, которые летают так точно, как голуби , что могут обманывать других голубей». Другие исследователи и аналитики не согласны и утверждают, что ИИ должен имитировать естественный интеллект, изучая психология или нейробиология .

Парадигма интеллектуального агента определяет интеллектуальное поведение в целом, безотносительно к людям. Интеллектуальный агент — это система, которая воспринимает окружающую среду и предпринимает действия, максимизирующие ее шансы на успех. Любая система, имеющая целенаправленное поведение, может быть проанализирована как интеллектуальный агент: что-то такое простое, как термостат, такое сложное, как человек, а также большие системы, такие как фирмы , биомы или нации . Парадигма интеллектуального агента получила широкое признание в 1990-х годах и в настоящее время служит определением области.

Парадигма имеет и другие преимущества для ИИ. Он обеспечивает надежный и научный способ тестирования программ; исследователи могут напрямую сравнивать или даже комбинировать различные подходы к отдельным проблемам, задавая вопрос, какой агент лучше всего максимизирует заданную «целевую функцию». Это также дает им общий язык для общения с другими областями, такими как математическая оптимизация (которая определяется в терминах «целей») или экономика (в которой используется то же определение « рационального агента »).

Оценка подходов к ИИ

Никакая устоявшаяся объединяющая теория или парадигма не руководила исследованиями ИИ на протяжении большей части его истории. Беспрецедентный успех статистического машинного обучения в 2010-х затмил все остальные подходы (настолько, что некоторые источники, особенно в деловом мире, используют термин «искусственный интеллект» для обозначения «машинного обучения с нейронными сетями»). Этот подход в основном субсимвольный , аккуратный , мягкий и узкий (см. ниже). Критики утверждают, что к этим вопросам, возможно, придется вернуться будущим поколениям исследователей ИИ.

Символический ИИ и его ограничения

Символический ИИ (или « GOFAI ») имитировал сознательное мышление высокого уровня, которое люди используют, когда решают головоломки, выражают юридические рассуждения и занимаются математикой. Они очень успешно справлялись с «интеллектуальными» задачами, такими как алгебра или тесты IQ. В 1960-х годах Ньюэлл и Саймон предложили гипотезу систем физических символов: «Система физических символов имеет необходимые и достаточные средства для общих интеллектуальных действий».

Однако символический подход потерпел неудачу во многих задачах, которые люди решают легко, таких как обучение, распознавание объекта или рассуждения на основе здравого смысла. Парадокс Моравека заключается в открытии того, что «интеллектуальные» задачи высокого уровня были просты для ИИ, но «инстинктивные» задачи низкого уровня были чрезвычайно сложными. Философ Хьюберт Дрейфус с 1960-х годов утверждал, что человеческий опыт зависит от бессознательных инстинктов, а не от сознательного манипулирования символами, и от «чувства» ситуации, а не от явного символического знания. Хотя его аргументы были высмеяны и проигнорированы, когда они впервые были представлены, в конце концов, исследования ИИ пришли к согласию.

Проблема не решена: субсимволические рассуждения могут совершать многие из тех же непостижимых ошибок, что и человеческая интуиция, например, алгоритмическую предвзятость . Критики, такие как Ноам Хомский , утверждают, что продолжение исследований символического ИИ по-прежнему необходимо для достижения общего интеллекта, отчасти потому, что субсимволический ИИ — это шаг в сторону от объяснимого ИИ : может быть трудно или невозможно понять, почему современная статистическая программа ИИ создала конкретное решение.

Аккуратный против неряшливого

«Ниты» надеются, что интеллектуальное поведение описывается с помощью простых и элегантных принципов (таких как логика , оптимизация или нейронные сети ). «Неряшливые» рассчитывают, что это обязательно потребует решения большого количества не связанных между собой задач. Этот вопрос активно обсуждался в 70-х и 80-х годах, но в 1990-х математические методы и твердые научные стандарты стали нормой, переход, который Рассел и Норвиг назвали «победой аккуратистов».

Мягкие и жесткие вычисления

Поиск доказуемо правильного или оптимального решения для многих важных задач является неразрешимой задачей . Мягкие вычисления — это набор методов, включая генетические алгоритмы , нечеткую логику и нейронные сети , которые терпимы к неточностям, неопределенности, частичной правде и приближениям. Мягкие вычисления были введены в конце 80-х, и наиболее успешные программы ИИ в 21 веке являются примерами мягких вычислений с нейронными сетями .

Узкий против общего ИИ

Исследователи ИИ разделились во мнениях относительно того, преследовать ли цели искусственного общего интеллекта и сверхразума (общий ИИ) напрямую или решать как можно больше конкретных проблем (узкий ИИ) в надежде, что эти решения косвенно приведут к долгосрочным целям в этой области. интеллект трудно определить и трудно измерить, и современный ИИ добился более поддающихся проверке успехов, сосредоточившись на конкретных проблемах с конкретными решениями. Экспериментальная подобласть искусственного общего интеллекта изучает исключительно эту область.

Машинное сознание, разум и разум

Философия разума не знает, может ли машина иметь разум , сознание и ментальные состояния в том же смысле, что и люди. В этом выпуске рассматриваются внутренние переживания машины, а не ее внешнее поведение. Основные исследования ИИ считают этот вопрос неактуальным, поскольку он не влияет на цели в этой области. Стюарт Рассел и Питер Норвиг отмечают, что большинство исследователей ИИ «не заботятся о [философии ИИ] — пока программа работает, им все равно, называете ли вы это симуляцией интеллекта или настоящим интеллектом». Однако этот вопрос стал центральным в философии сознания. Это также типично центральный вопрос в области искусственного интеллекта в художественной литературе .

Сознание

Дэвид Чалмерс выделил две проблемы в понимании разума, которые он назвал «трудными» и «легкими» проблемами сознания. Простая задача — понять, как мозг обрабатывает сигналы, строит планы и контролирует поведение. Трудная проблема состоит в том, чтобы объяснить, как это ощущается или почему это вообще должно ощущаться как что-либо. Обработку информации человеком легко объяснить, однако субъективный человеческий опыт объяснить трудно. Например, легко представить дальтоника, который научился определять, какие объекты в его поле зрения красные, но неясно, что потребуется, чтобы человек узнал, как выглядит красный цвет .

Вычислительность и функционализм

Вычислительность — это позиция в философии разума , согласно которой человеческий разум — это система обработки информации, а мышление — форма вычислений. Компьютеризм утверждает, что отношения между разумом и телом аналогичны или идентичны отношениям между программным обеспечением и оборудованием и, таким образом, могут быть решением проблемы разума и тела . Эта философская позиция была вдохновлена работой исследователей ИИ и когнитивистов в 1960-х годах и первоначально была предложена философами Джерри Фодором и Хилари Патнэм .

Философ Джон Сирл охарактеризовал эту позицию как «сильный ИИ» : «Соответствующим образом запрограммированный компьютер с правильными входами и выходами, таким образом, будет иметь разум точно в том же смысле, что и человеческие существа». Сирл противопоставляет этому утверждению свой аргумент китайской комнаты, который пытается показать, что, даже если машина идеально имитирует человеческое поведение, все равно нет причин предполагать, что она также обладает разумом.

Права роботов

Если у машины есть разум и субъективный опыт, то у нее может быть и сенсиент (способность чувствовать), а если так, то она тоже может страдать , а значит, она будет иметь определенные права. Любые гипотетические права роботов будут лежать в одном спектре с правами животных и правами человека. Этот вопрос рассматривался в художественной литературе на протяжении столетий, а сейчас рассматривается, например, Калифорнийским институтом будущего , однако критики утверждают, что дискуссия преждевременна.

Будущее

Сверхразум

Сверхразум, гиперинтеллект или сверхчеловеческий интеллект — это гипотетический агент, обладающий интеллектом, намного превосходящим интеллект самого яркого и одаренного человеческого ума. Сверхразум может также относиться к форме или степени интеллекта, которым обладает такой агент.

Если исследования искусственного общего интеллекта создадут достаточно интеллектуальное программное обеспечение, оно сможет перепрограммироваться и самосовершенствоваться. Усовершенствованное программное обеспечение будет еще лучше улучшать себя, что приведет к рекурсивному самосовершенствованию . Его интеллект будет расти экспоненциально в результате взрыва интеллекта и может значительно превзойти человеческий. Писатель-фантаст Вернор Виндж назвал этот сценарий «сингулярностью». Поскольку трудно или невозможно узнать пределы интеллекта или возможности сверхразумных машин, технологическая сингулярность — это явление, за пределами которого события непредсказуемы или даже непостижимы.

Создатель роботов Ханс Моравек , кибернетик Кевин Уорвик и изобретатель Рэй Курцвейл предсказали, что в будущем люди и машины сольются в киборгов , которые будут более способными и могущественными, чем они. Эта идея, называемая трансгуманизмом, уходит корнями в Олдоса Хаксли и Роберта Эттингера .

Эдвард Фредкин утверждает, что «искусственный интеллект — это следующий этап эволюции». Эта идея впервые была предложена Сэмюэлем Батлером в книге « Дарвин среди машин » еще в 1863 году и развита Джорджем Дайсоном в его одноименной книге в 1863 году. 1998.

Риски

Технологическая безработица

В прошлом технологии имели тенденцию увеличивать, а не сокращать общую занятость, но экономисты признают, что с ИИ «мы находимся на неизведанной территории». Опрос экономистов показал разногласия по поводу того, приведет ли более широкое использование роботов и ИИ к существенному увеличению долгосрочной безработицы , но в целом они согласны с тем, что это может быть чистой выгодой, если перераспределить прирост производительности . Субъективные оценки риска сильно различаются; например, по оценкам Майкла Осборна и Карла Бенедикта Фрея , 47% рабочих мест в США подвержены «высокому риску» потенциальной автоматизации, в то время как в отчете ОЭСР только 9% рабочих мест в США классифицируются как «высокий риск».

В отличие от предыдущих волн автоматизации, многие рабочие места среднего класса могут быть устранены искусственным интеллектом; The Economist заявляет, что «беспокойство по поводу того, что ИИ может сделать с рабочими местами белых воротничков то, что паровая энергия сделала с рабочими во время промышленной революции», «заслуживает серьезного отношения». Профессии с повышенным риском варьируются от параюристов до поваров быстрого питания, в то время как спрос на рабочие места, вероятно, возрастет для профессий, связанных с уходом, от личного здравоохранения до духовенства.

Плохие актеры и вооружённый ИИ

ИИ предоставляет ряд инструментов, которые особенно полезны для авторитарных правительств: интеллектуальное шпионское ПО , распознавание лиц и голоса позволяют вести широкомасштабную слежку ; такая слежка позволяет машинному обучению классифицировать потенциальных врагов государства и может помешать им скрыться; системы рекомендаций могут точно нацеливаться на пропаганду и дезинформацию для достижения максимального эффекта; дипфейки помогают создавать дезинформацию; продвинутый ИИ может сделать централизованное принятие решений более конкурентоспособным по сравнению с либеральными и децентрализованными системами, такими как рынки.

Террористы, преступники и государства-изгои могут использовать другие формы вооруженного ИИ, такие как продвинутая цифровая война и смертоносное автономное оружие . К 2015 году сообщалось, что более пятидесяти стран исследуют боевых роботов.

ИИ с машинным обучением также может создавать десятки тысяч токсичных молекул за считанные часы.

Алгоритмический уклон

Программы ИИ могут стать предвзятыми после обучения на реальных данных. Обычно это не вводится разработчиками системы, а изучается программой, поэтому программисты часто не подозревают о существовании смещения. Смещение может быть непреднамеренно введено способом выбора обучающих данных . Это также может возникнуть из корреляций : ИИ используется для классификации людей по группам, а затем делает прогнозы, предполагая, что человек будет похож на других членов группы. В некоторых случаях это предположение может быть несправедливым. Примером этого является COMPAS , коммерческая программа, широко используемая судами США для оценки вероятности того, что подсудимый станет рецидивистом . ProPublica утверждает, что установленный COMPAS уровень риска рецидивизма для черных подсудимых с гораздо большей вероятностью будет завышен, чем для белых подсудимых, несмотря на то, что программа не сообщила расы подсудимых. Другими примерами, когда алгоритмическая предвзятость может привести к несправедливым результатам, являются случаи, когда ИИ используется для оценки кредитоспособности или найма .

На своей Конференции по справедливости, подотчетности и прозрачности 2022 года (ACM FAccT 2022) Ассоциация вычислительной техники в Сеуле, Южная Корея, представила и опубликовала выводы, в которых рекомендуется, что до тех пор, пока системы ИИ и робототехники не продемонстрируют отсутствие ошибок предвзятости, они небезопасно, а использование самообучающихся нейронных сетей, обученных на обширных нерегулируемых источниках ошибочных интернет-данных, должно быть ограничено.

Экзистенциальный риск

Сверхразумный ИИ может улучшить себя до такой степени, что люди не смогут его контролировать. Это может, как выразился физик Стивен Хокинг , « означать конец человеческой расы ». Философ Ник Бостром утверждает, что достаточно интеллектуальный ИИ, если он выбирает действия, основанные на достижении какой-либо цели, будет демонстрировать конвергентное поведение, такое как приобретение ресурсов или защита от отключения. Если цели этого ИИ не полностью отражают цели человечества, ему, возможно, придется нанести вред человечеству, чтобы получить больше ресурсов или предотвратить свое закрытие, в конечном итоге для лучшего достижения своей цели. Он заключает, что ИИ представляет опасность для человечества, какими бы скромными или « дружественными » ни были заявленные цели. Политолог Чарльз Т. Рубин утверждает, что «любая достаточно развитая доброжелательность может быть неотличима от недоброжелательности». Люди не должны предполагать, что машины или роботы будут относиться к нам благосклонно, потому что нет априорных оснований полагать, что они разделят нашу систему морали.

Мнения экспертов и отраслевых инсайдеров неоднозначны: значительная часть как обеспокоена, так и не обеспокоена риском возможного создания ИИ со сверхчеловеческими способностями. Стивен Хокинг , основатель Microsoft Билл Гейтс , профессор истории Юваль Ной Харари и основатель SpaceX Илон Маск выразили серьезные опасения по поводу будущего ИИ. Выдающиеся технические титаны, включая Питера Тиля ( Amazon Web Services ) и Маска, выделили более 1 миллиарда долларов некоммерческим компаниям, которые отстаивают ответственную разработку ИИ, таким как OpenAI и Future of Life Institute . Марк Цукерберг (генеральный директор Facebook) сказал, что искусственный интеллект полезен в его нынешнем виде и будет продолжать помогать людям. Другие эксперты утверждают, что риски в будущем достаточно далеки, чтобы их не стоило исследовать, или что люди будут ценны с точки зрения сверхразумной машины. Родни Брукс , в частности, сказал, что до появления «злого» ИИ еще столетия.

Этические машины

Дружественный ИИ — это машины, которые с самого начала разрабатывались для минимизации рисков и принятия решений, приносящих пользу людям. Элиезер Юдковски , придумавший этот термин, утверждает, что разработка дружественного ИИ должна быть более приоритетной задачей исследований: она может потребовать больших инвестиций и должна быть завершена до того, как ИИ станет экзистенциальным риском.

Машины с интеллектом могут использовать свой интеллект для принятия этических решений. Область машинной этики предоставляет машинам этические принципы и процедуры для решения этических дилемм. Машинная этика также называется машинной моралью , вычислительной этикой или вычислительной моралью и была основана на симпозиуме AAAI в 2005 году.

Другие подходы включают «искусственных моральных агентов» Венделла Уоллаха и три принципа Стюарта Дж. Рассела для разработки доказуемо полезных машин.

Регулирование

Регулирование искусственного интеллекта - это разработка политики и законов государственного сектора для продвижения и регулирования искусственного интеллекта (ИИ); следовательно, это связано с более широким регулированием алгоритмов. Нормативная и политическая среда для ИИ является новой проблемой в юрисдикциях по всему миру. В период с 2016 по 2020 год более 30 стран приняли специальные стратегии для ИИ. Большинство государств-членов ЕС выпустили национальные стратегии искусственного интеллекта, как и Канада, Китай, Индия, Япония, Маврикий, Российская Федерация, Саудовская Аравия, Объединенные Арабские Эмираты, США и Вьетнам. Другие, включая Бангладеш, Малайзию и Тунис, находились в процессе разработки собственной стратегии искусственного интеллекта. Глобальное партнерство по искусственному интеллекту было запущено в июне 2020 года, в нем говорится о необходимости разработки ИИ в соответствии с правами человека и демократическими ценностями, чтобы обеспечить общественное доверие и доверие к технологии. Генри Киссинджер , Эрик Шмидт и Дэниел Хаттенлохер в ноябре 2021 года опубликовали совместное заявление, призывающее к созданию правительственной комиссии по регулированию ИИ.

В художественной литературе

Способные к мышлению искусственные существа появлялись как устройства для повествования с древних времен и были постоянной темой в научной фантастике .

Общий образ в этих произведениях начался с « Франкенштейна » Мэри Шелли , где человеческое творение становится угрозой для своих хозяев. Сюда входят такие работы, как « 2001: Космическая одиссея» Артура Кларка и Стэнли Кубрика (обе 1968 г.) с HAL 9000 , убийственным компьютером, управляющим космическим кораблем « Дискавери -1» , а также «Терминатор » (1984 г.) и «Матрица » (1999 г.). ). Напротив, редкие лояльные роботы, такие как Горт из «Дня, когда Земля остановилась» (1951) и Бишоп из « Чужих » (1986), менее заметны в популярной культуре.

Исаак Азимов представил Три закона робототехники во многих книгах и рассказах, в первую очередь в серии «Мультивак» о сверхинтеллектуальном компьютере с одноименным названием. Законы Азимова часто упоминаются в ходе непрофессиональных дискуссий об этике машин; хотя почти все исследователи искусственного интеллекта знакомы с законами Азимова из популярной культуры, они обычно считают эти законы бесполезными по многим причинам, одной из которых является их двусмысленность.

Трансгуманизм (слияние людей и машин) исследуется в манге «Призрак в доспехах » и научно-фантастическом сериале « Дюна » .

Несколько работ используют ИИ, чтобы заставить нас ответить на фундаментальный вопрос о том, что делает нас людьми, показывая нам искусственных существ, которые обладают способностью чувствовать и, следовательно, страдать. Это появляется в RUR Карела Чапека , фильмах AI Artificial Intelligence и Ex Machina , а также в романе Мечтают ли андроиды об электрических овцах? , Филип К. Дик . Дик рассматривает идею о том, что наше понимание человеческой субъективности изменено технологиями, созданными с помощью искусственного интеллекта.

Научная дипломатия

Военное дело

По мере того, как технологии и исследования развиваются, и мир вступает в третью революцию в военном деле после порохового и ядерного оружия, начинается гонка вооружений искусственного интеллекта между Соединенными Штатами, Китаем и Россией, тремя странами с крупнейшими в мире военными бюджетами. О намерениях стать мировым лидером в исследованиях ИИ к 2030 году заявил лидер Китая Си Цзиньпин, а президент России Путин заявил, что «кто станет лидером в этой сфере, тот станет правителем мира». Если бы Россия стала лидером в исследованиях ИИ, президент Путин заявил о намерении России поделиться некоторыми своими исследованиями с миром, чтобы не монополизировать эту область, подобно их нынешнему обмену ядерными технологиями, поддерживая отношения научной дипломатии. Соединенные Штаты, Китай и Россия — вот некоторые примеры стран, которые заняли свою позицию в отношении военного искусственного интеллекта еще в 2014 году, разработав военные программы для разработки кибероружия, управления смертоносным автономным оружием и беспилотниками, которые можно использовать в военных целях . наблюдение .

Русско-украинская война

Президент Путин объявил, что искусственный интеллект — это будущее для всего человечества, и признает силу и возможности, которые разработка и развертывание технологии смертоносного автономного оружия с искусственным интеллектом могут иметь в военном деле и национальной безопасности, а также связанные с этим угрозы. Прогноз президента Путина о том, что войны в будущем будут вестись с использованием ИИ, начал сбываться после того , как 24 февраля 2022 года Россия вторглась в Украину . Украинские военные используют турецкие дроны Bayraktar TB2 , которые по-прежнему требуют участия человека для развертывания бомб с лазерным наведением, но могут взлетать, приземляться и летать автономно. Украина также использует беспилотники Switchblade , поставленные США, и получает информацию, собираемую собственными операциями США по наблюдению в отношении разведки поля боя и национальной безопасности о России. Точно так же Россия может использовать ИИ для анализа данных о поле боя из видеозаписей, снятых беспилотниками. Отчеты и изображения показывают, что российские военные направили в Украину беспилотники-смертники KUB-BLA с предположениями о намерениях убить президента Украины Владимира Зеленского .

Правила ведения войны

По мере того, как исследования в области ИИ продвигаются, использование ИИ вызывает возражения со стороны Кампании по борьбе с роботами -убийцами , и мировые технологические лидеры направили в ООН петицию с призывом к новым правилам разработки и использования технологий ИИ в 2017 году. включая запрет на использование смертоносного автономного оружия из-за этических соображений невинного гражданского населения.

Кибербезопасность

С постоянно развивающимися кибератаками и поколением устройств ИИ можно использовать для обнаружения угроз и более эффективного реагирования за счет приоритизации рисков. С этим инструментом также возникают некоторые проблемы, такие как конфиденциальность, информированное согласие и ответственное использование. По данным CISA , киберпространство сложно защитить из-за следующих факторов: способность злоумышленников действовать из любой точки мира, связи между киберпространством и физическими системами, а также сложность снижения уязвимостей и последствий в сложных киберсетях. С ростом технического прогресса в мире возрастает риск крупномасштабных последствий. Как это ни парадоксально, способность защитить информацию и создать линию связи между научным и дипломатическим сообществом процветает. Роль кибербезопасности в дипломатии становится все более актуальной, что привело к появлению термина кибердипломатия , который не имеет однозначного определения и не является синонимом киберзащиты . Многие страны разработали уникальные подходы к научной дипломатии в киберпространстве.

Подход Чешской Республики

Начиная с 2011 года, когда Чешское управление национальной безопасности (АНБ) было назначено национальным органом по кибер-повестке дня. Роль кибердипломатии усилилась в 2017 году, когда Министерство иностранных дел (МИД) Чехии обнаружило серьезную киберкампанию, направленную против его собственных компьютерных сетей. В 2016 году три кибер-дипломата были направлены в Вашингтон, округ Колумбия, Брюссель и Тель-Авив, с целью налаживания активного международного сотрудничества, ориентированного на взаимодействие с ЕС и НАТО . Основная цель этих усилий в области научной дипломатии заключается в поддержке исследований в области искусственного интеллекта и способов его использования в исследованиях и разработках в области кибербезопасности, а также в повышении общего доверия потребителей. CzechInvest является ключевым участником научной дипломатии и кибербезопасности. Например, в сентябре 2018 года они организовали миссию в Канаду в сентябре 2018 года с особым акцентом на искусственный интеллект. Основной целью этой конкретной миссии была рекламная акция от имени Праги, направленная на то, чтобы превратить ее в будущий центр знаний в отрасли для заинтересованных канадских фирм.

подход Германии

Кибербезопасность признана государственной задачей, в обязанности которой входят три министерства: федеральное министерство внутренних дел, федеральное министерство обороны и федеральное министерство иностранных дел. Эти отличия способствовали созданию различных учреждений, таких как Немецкое национальное управление информационной безопасности, Национальный центр киберзащиты, Немецкий национальный совет по кибербезопасности и Служба киберпространства и информационных доменов. В 2018 году правительство Германии разработало новую стратегию в области искусственного интеллекта с созданием немецко-французской виртуальной исследовательской и инновационной сети, открывающей возможности для расширения исследований в области кибербезопасности.

Подход Европейского Союза

Принятие в 2013 году Европейской комиссией документа «Стратегия кибербезопасности Европейского союза — открытое, безопасное и надежное киберпространство » подтолкнуло усилия в области кибербезопасности, интегрированные с научной дипломатией и искусственным интеллектом. Усилия сильны, так как ЕС финансирует различные программы и учреждения, стремясь привнести науку в дипломатию и привнести дипломатию в науку. Некоторыми примерами являются программа кибербезопасности Competence Research Innovation (CONCORDIA), которая объединяет 14 государств-членов, Cybersecurity for Europe (CSE), которая объединяет 43 партнера с участием 20 государств-членов. Кроме того, Европейская сеть центров кибербезопасности и Компетентный центр инноваций и операций (ECHO) объединяет 30 партнеров из 15 государств-членов, а SPARTA объединяет 44 партнера с участием 14 государств-членов. Эти усилия отражают общие цели ЕС по внедрению инноваций в кибербезопасность для обороны и защиты, созданию высокоинтегрированного киберпространства между многими странами и дальнейшему вкладу в безопасность искусственного интеллекта.

Русско-украинская война

После вторжения в Украину в 2022 году увеличилась злонамеренная киберактивность против США, Украины и России. Заметное и редкое задокументированное использование искусственного интеллекта в конфликте происходит от имени Украины, используя программное обеспечение для распознавания лиц, чтобы раскрыть российских нападавших и идентифицировать украинцев, погибших в продолжающейся войне. Хотя эти правительственные деятели в первую очередь не сосредоточены на научной и кибердипломатии, другие учреждения комментируют использование искусственного интеллекта в кибербезопасности с этой целью. Например, Центр безопасности и новых технологий Джорджтаунского университета (CSET) реализует проект Cyber-AI, одной из целей которого является привлечение внимания политиков к растущему объему академических исследований, раскрывающих эксплуататорские последствия ИИ и машинного обучения (ML). ) алгоритмы. Эта уязвимость может быть правдоподобным объяснением того, почему Россия не использует ИИ в конфликте, считает старший научный сотрудник CSET Эндрю Лон . Помимо использования на поле боя, ИИ используется Пентагоном для анализа данных о войне, анализа для усиления кибербезопасности и военной разведки для Соединенных Штатов.

Безопасность выборов

По мере роста искусственного интеллекта и увеличения огромного количества новостей, передаваемых через киберпространство, избирателю становится чрезвычайно трудно понять, чему верить. Существует множество интеллектуальных кодов, называемых ботами, написанных для изображения людей в социальных сетях с целью распространения информации об ошибках. Жертвой таких действий стали выборы в США в 2016 году. Во время кампании Хиллари Клинтон и Дональда Трампа боты с искусственным интеллектом из России распространяли дезинформацию о кандидатах, чтобы помочь кампании Трампа. Аналитики пришли к выводу, что примерно 19% твитов , посвященных выборам 2016 года, были отправлены ботами. YouTube в последние годы также использовался для распространения политической информации. Хотя нет никаких доказательств того, что платформа пытается манипулировать мнением своих зрителей, алгоритм искусственного интеллекта Youtube рекомендует видео подобного разнообразия. Если человек начнет изучать правые политические подкасты, алгоритм YouTube порекомендует больше правых видео. Восстание в программе под названием Deepfake , используемой для воспроизведения чьего-то лица и слов, также показало свою потенциальную угрозу. В 2018 году было выпущено видео Deepfake, на котором Барак Обама произносит слова, которые, как он утверждает, никогда не произносил. В то время как на национальных выборах Deepfake будет быстро развенчан, программное обеспечение может сильно повлиять на небольшие местные выборы . Этот инструмент имеет большой потенциал для распространения дезинформации и контролируется с большим вниманием. Хотя ИИ может рассматриваться как инструмент, используемый для нанесения вреда, он также может помочь улучшить избирательные кампании. Боты с искусственным интеллектом могут быть запрограммированы на нацеливание на статьи с известной дезинформацией. Затем боты могут указать, что дезинформируют, чтобы помочь пролить свет на правду. ИИ также можно использовать для информирования человека о том, какое отношение каждая часть имеет к определенной теме, такой как здравоохранение или изменение климата . Политические лидеры нации имеют большое влияние на международные дела. Таким образом, политический лидер, не заинтересованный в международном совместном научном прогрессе, может оказать негативное влияние на научную дипломатию этой страны.

Будущее работы

Распознавание лиц

Использование искусственного интеллекта (ИИ) постепенно стало частью повседневной жизни. Он используется каждый день в программах распознавания лиц . Это первая мера безопасности для многих компаний в виде биометрической аутентификации. Это средство аутентификации позволяет даже самым официальным организациям, таким как Служба внутренних доходов США, проверять личность человека с помощью базы данных, созданной с помощью машинного обучения. С 2022 года IRS США требует, чтобы те, кто не проходит интервью с агентом в прямом эфире, прошли биометрическую проверку своей личности с помощью инструмента распознавания лиц ID.me.

ИИ и школа

В Японии и Южной Корее программное обеспечение искусственного интеллекта используется при обучении английскому языку через компанию Riiid. Riiiid — корейская образовательная компания, работающая вместе с Японией, чтобы предоставить учащимся средства для изучения и использования своих навыков общения на английском языке посредством взаимодействия с искусственным интеллектом в чате. Riid — не единственная компания, которая делает это. Американская компания, такая как Duolingo , очень известна своим автоматизированным обучением 41 языку. Babbel , программа изучения немецкого языка, также использует искусственный интеллект для автоматизации обучения, позволяя европейским студентам осваивать жизненно важные навыки общения, необходимые в социальных, экономических и дипломатических условиях. Искусственный интеллект также автоматизирует рутинные задачи, которые должны выполнять учителя, такие как выставление оценок, учет посещаемости и обработка рутинных запросов учащихся. Это позволяет учителю решать сложные задачи обучения, с которыми автоматическая машина справиться не может. К ним относятся создание экзаменов, объяснение сложного материала таким образом, чтобы это было полезно для учащихся, и ответы на уникальные вопросы учащихся.

ИИ и медицина

В отличие от человеческого мозга, обладающего обобщенным интеллектом, специализированный интеллект ИИ может служить средством поддержки врачей на международном уровне. Медицинская сфера располагает разнообразными и обширными данными, которые ИИ может использовать для постановки предиктивного диагноза. Исследователи из Оксфордской больницы разработали искусственный интеллект, который может диагностировать сердечно-сосудистые заболевания и рак. Этот искусственный интеллект может улавливать мельчайшие детали сканирования, которые врачи могут пропустить. Таким образом, искусственный интеллект в медицине улучшит отрасль, предоставив врачам возможность точно диагностировать своих пациентов с помощью доступных инструментов. Алгоритмы искусственного интеллекта также будут использоваться для дальнейшего улучшения диагностики с течением времени с помощью применения машинного обучения, называемого точной медициной. Кроме того, узкое применение искусственного интеллекта может использовать « глубокое обучение » для улучшения анализа медицинских изображений. В радиологической визуализации ИИ использует алгоритмы глубокого обучения для выявления потенциально раковых поражений, что является важным процессом, помогающим в ранней диагностике.

ИИ в бизнесе

Анализ данных — это фундаментальное свойство искусственного интеллекта, которое позволяет использовать его во всех сферах жизни, от результатов поиска до того, как люди покупают товары. По данным NewVantage Partners, более 90% ведущих компаний постоянно инвестируют в искусственный интеллект. По данным IBM, одного из мировых лидеров в области технологий, 45% респондентов из компаний с более чем 1000 сотрудников внедрили ИИ. Последние данные показывают, что бизнес-рынок искусственного интеллекта в 2020 году оценивался в 51,08 миллиарда долларов. По прогнозам, к 2028 году бизнес-рынок искусственного интеллекта превысит 640,3 миллиарда долларов. Чтобы предотвратить ущерб, организации, внедряющие ИИ, должны играть центральную роль в создании и развертывании надежного ИИ в соответствии с принципами надежного ИИ и брать на себя ответственность. чтобы снизить риски.

Бизнес и дипломатия

С экспоненциальным всплеском искусственных технологий и коммуникаций в повседневной жизни стало очевидным распространение чьих-либо идеалов и ценностей. Цифровая информация распространяется через коммуникационные приложения, такие как Whatsapp, Facebook/Meta, Snapchat, Instagram и Twitter. Однако известно, что эти сайты передают конкретную информацию, соответствующую анализу данных. Если бы человек правого толка выполнял поиск в Google, алгоритмы Google нацеливались бы на этого человека и передавали данные, относящиеся к этой целевой аудитории. Президент США Билл Клинтон заметил в 2000 году: «В новом столетии свобода будет распространяться с помощью сотовых телефонов и кабельных модемов. [...] Мы знаем, насколько Интернет изменил Америку, и мы уже являемся открытым обществом. Однако, когда частный сектор использует искусственный интеллект для сбора данных, можно увидеть переход власти от государства к частному сектору.Это изменение власти, особенно в крупных технологических корпорациях, может коренным образом изменить то, как дипломатия функционирует в обществе.Рост цифровых технологий а использование искусственных технологий позволило частному сектору собирать огромные данные об обществе, которые затем классифицируются по расе, местоположению, возрасту, полу и т. д. New York Times подсчитала, что «десять крупнейших технологических фирм, которые стали привратниками в коммерции, финансах, развлечениях и коммуникациях, в настоящее время имеют совокупную рыночную капитализацию более 10 триллионов долларов. С точки зрения валового внутреннего продукта, это сделало бы их третьей по величине экономикой в мире».

ИИ и внешняя политика

Несколько стран по всему миру используют искусственный интеллект для помощи в принятии внешнеполитических решений. Департамент внешней безопасности Китая при Министерстве иностранных дел использует ИИ для проверки почти всех своих иностранных инвестиционных проектов на предмет снижения рисков. Правительство Китая планирует использовать искусственный интеллект в своем плане развития глобальной инфраструктуры стоимостью 900 миллиардов долларов, который называется «Инициатива пояса и пути» для снижения политических, экономических и экологических рисков.

Более 200 приложений искусственного интеллекта используются более чем 46 агентствами Организации Объединенных Наций в различных секторах, от здравоохранения, занимающегося такими вопросами, как борьба с COVID-19, до умного сельского хозяйства, чтобы помочь ООН в политических и дипломатических отношениях. Одним из примеров является использование ИИ программой ООН Global Pulse для моделирования воздействия распространения COVID-19 на внутренне перемещенных лиц (ВПЛ) и поселения беженцев, чтобы помочь им в разработке соответствующей глобальной политики в области здравоохранения.

Новые инструменты искусственного интеллекта, такие как дистанционное зондирование, также могут использоваться дипломатами для сбора и анализа данных и отслеживания объектов, таких как перемещение войск или беженцев вдоль границ в зонах ожесточенных конфликтов, в режиме, близком к реальному времени.

Искусственный интеллект можно использовать для смягчения жизненно важных международных дипломатических переговоров, чтобы предотвратить ошибки перевода, вызванные переводчиками-людьми. Ярким примером являются встречи в Анкоридже в 2021 году, проведенные между США и Китаем, направленные на стабилизацию международных отношений, только для того, чтобы иметь противоположный эффект, усилив напряженность и агрессивность между двумя странами из-за ошибок перевода, допущенных переводчиками-людьми. На встрече, когда советник президента США по национальной безопасности Джо Байдена Джейкоб Джеремайя Салливан заявил: «Мы не ищем конфликтов, но приветствуем жесткую конкуренцию, и мы всегда будем отстаивать наши принципы, наш народ и наших друзей. ", это было неправильно переведено на китайский язык как "мы столкнемся с конкуренцией между собой и очень четко представим нашу позицию", что придало речи агрессивный тон. Способность ИИ к быстрой и эффективной обработке естественного языка, а также к переводу и транслитерации в реальном времени делает его важным инструментом для внешнеполитического общения между странами и предотвращает непреднамеренный неправильный перевод.

Смотрите также

- Восхождение ИИ

- Проблема управления ИИ

- Гонка вооружений искусственного интеллекта

- Искусственный общий интеллект

- Алгоритм выбора поведения

- Автоматизация бизнес-процессов

- Рассуждение на основе прецедентов

- Гражданская наука

- Возникающий алгоритм

- Женский гендер в технологиях ИИ

- Глоссарий искусственного интеллекта

- Роботизированная автоматизация процессов

- Синтетический интеллект

- Универсальный базовый доход

- Слабый ИИ

Заметки с пояснениями

Цитаты

использованная литература

- Атрибуция

-

Эта статья включает текст из работы с бесплатным контентом . Под лицензией C-BY-SA 3.0 IGO Текст взят из Доклада ЮНЕСКО по науке: гонка со временем для более разумного развития. , Шнееганс, С., Т. Страза и Дж. Льюис (редакторы), ЮНЕСКО.

Эта статья включает текст из работы с бесплатным контентом . Под лицензией C-BY-SA 3.0 IGO Текст взят из Доклада ЮНЕСКО по науке: гонка со временем для более разумного развития. , Шнееганс, С., Т. Страза и Дж. Льюис (редакторы), ЮНЕСКО.

учебники по ИИ

Это были четыре наиболее широко используемых учебника по ИИ в 2008 году:

- Люгер, Джордж ; Стаблфилд, Уильям (2004). Искусственный интеллект: структуры и стратегии для решения сложных проблем (5-е изд.). Бенджамин/Каммингс. ISBN 978-0-8053-4780-7. Архивировано из оригинала 26 июля 2020 года . Проверено 17 декабря 2019 г.

- Нильссон, Нильс (1998). Искусственный интеллект: новый синтез . Морган Кауфманн. ISBN 978-1-55860-467-4. Архивировано из оригинала 26 июля 2020 года . Проверено 18 ноября 2019 г.

- Рассел, Стюарт Дж. ; Норвиг, Питер (2003), Искусственный интеллект: современный подход (2-е изд.), Аппер-Сэдл-Ривер, Нью-Джерси: Прентис-Холл, ISBN 0-13-790395-2.

- Пул, Дэвид ; Макворт, Алан ; Гебель, Рэнди (1998). Вычислительный интеллект: логический подход . Нью-Йорк: Издательство Оксфордского университета. ISBN 978-0-19-510270-3. Архивировано из оригинала 26 июля 2020 года . Проверено 22 августа 2020 г.

Более поздние выпуски.

- Рассел, Стюарт Дж. ; Норвиг, Питер (2009). Искусственный интеллект: современный подход (3-е изд.). Река Аппер-Сэдл, Нью-Джерси: Прентис-холл. ISBN 978-0-13-604259-4..

- Пул, Дэвид ; Макворт, Алан (2017). Искусственный интеллект: основы вычислительных агентов (2-е изд.). Издательство Кембриджского университета. ISBN 978-1-107-19539-4.

Два наиболее популярных учебника в 2021 году. Open Syllabus: Explorer

- Рассел, Стюарт Дж. ; Норвиг, Питер (2021). Искусственный интеллект: современный подход (4-е изд.). Хобокен: Пирсон. ISBN 9780134610993. LCCN 20190474 .